Límites físicos de la computación clásica

Rubén Rodríguez Abril

La computación está sometida a limitaciones de carácter físico que restringen tanto la capacidad de almacenamiento como a la velocidad máxima a la que puede procesarse la información. Los problemas cuya solución sobrepasa estos límites se denominan transcomputacionales y son de facto insolubles para cualquier sistema físico realizable.

A diferencia de otros artículos de esta misma serie que hacen referencia de los límites lógicos e intrínsecos de la computación -vinculados al sistema axiomático subyacente y que generan la categoría de los problemas indecidibles– en esta ocasión abordaremos sus límites físicos. Éstos se derivan de la existencia de cotas máximas en la capacidad de almacenamiento y procesamiento de la información de una región determinada del espacio. Tales limitaciones definen el ámbito de los problemas transcomputacionales, que aunque teóricamente son solubles, en la práctica son inaccesibles para cualquier sistema físico realizable.

Límite de Bekenstein

Una región finita del espacio no puede almacenar una cantidad ilimitada de información. Existe una cota máxima, definida en el año 1981 por el físico norteamericano Jacob Bekenstein con la siguiente ecuación:

donde E es la cantidad de energía y R el radio de la región espacial de que se trate. El resto, son constantes. Es un límite que afecta a la cantidad máxima de estados de máquina distinguibles que puede tener un computador, así como al límite superior de memoria y capacidad computacional de este último.

Bekenstein desarrolló este límite a partir de su conjetura sobre la hipotética entropía (una variable estrechamente relacionada con la cantidad de información, no lo olvidemos) de los agujeros negros. Más tarde, el límite fue generalizado para toda clase de cuerpos física y acabó sentando las bases del denominado principio holográfico, que considera que la información presente en el Universo, aunque se refiera a la configuración tridimensional del mismo, en realidad está codificada en superficies bidimensionales, al estilo de lo que sucede en los hologramas.

Termodinámica de los agujeros negros

Puede que a muchos lectores les parezca sorprendente, pero buena parte de la teoría de la información se desarrolló en el marco de la termodinámica de los agujeros negros. Esta disciplina fue desarrollada por eminentes físicos relativistas como Jakob Bekenstein, Stephen Hawking, Roger Penrose o Demetrios Christodoulou entre muchos otros.

El vínculo entre entre estos misteriosos cuerpos estelares y la teoría de la información se deriva del hecho de que una vez que un cuerpo atraviesa el horizonte de sucesos (frontera exterior) de un agujero negro, nada puede escapar hacia el exterior, ni siquiera la radiación térmica que emitan los cuerpos en caída libre. El horizonte de sucesos actúa como una suerte de frontera opaca e impermeable que impide que cualquier tipo de información o entropía -incluso la transportada por señales luminosas- pueda permear hacia el exterior.

Figura 1. Impresión artística de un agujero negro. Su disco de acreción, coloreado de amarillo en la imagen, contiene una alta densidad de entropía que es “deglutida” por el mismo y desaparece del Universo visible. Este hecho conduce a una disyuntiva fundamental: o bien la segunda ley de la termodinámica es inválida en presencia de agujeros negros o bien estos últimos poseen entropía propia y tienen capacidad de almacenar información.

Sin embargo, la continua deglución de materia altamente entropizada (p.e. plasma de su disco de acreción) por parte del agujero negro parecería vulnerar la segunda ley de la termodinámica, en la medida en que el agujero actuaría como una suerte de sumidero irreversible de información, contribuyendo a la disminución de la entropía total del Universo. Para soslayar este consecuencia no deseada, la investigación especializada se vio forzada, a partir del artículo seminal Black Holes and Entropy (Bekenstein, 1972), a admitir las siguientes circunstancias:

1) Los agujeros negros tienen entropía, que puede definirse como una medida de la cantidad de información existente dentro de los mismos (relacionada con su configuración interna y tal vez con sus orígenes -si nacieron de una estrella normal o de una estrella de neutrones-) y que no es accesible desde el exterior.

2) La entropía de un agujero negro es directamente proporcional al área de su horizonte de sucesos según la ecuación de Bekenstein-Hawking:

donde η es una constante (que con posterioridad se fijó en ¼), A el área del horizonte y l2p el área de Planck. Establece el máximo de información que un agujero negro puede almacenar.

3) Los agujeros negros emiten radiación térmica (radiación de Hawking), que tiene sus orígenes en procesos de origen cuántico desarrollados en las inmediaciones del horizonte de sucesos.

4) La entropía global (que viene constituida por la suma de la entropía de los agujeros negros y de la entropía exterior) no puede disminuir.

En el año 1981, Bekenstein generalizó su límite a toda región del espacio, enunciando la ecuación con la que abrimos esta sección. En este esquema general, los agujeros negros constituirían un caso particular y extremo de este límite, representando a las regiones del espacio-tiempo con la mayor capacidad posible de almacenamiento de información.

Principio holográfico

Dado que el máximo de entropía posible en una región esférica del espacio es proporcional a la superficie de la esfera que la delimita, en los años 90 el físico neerlandés Gerhardus ’t Hofft puso las bases de lo que más tarde se conocería como principio holográfico. Esta idea revolucionaria sostiene que “toda la información relativa a una región del Universo está codificada en su superficie”.

Figura 2. Un gigantesco dispositivo cósmico de almacenamiento de información. Según el esquema de ‘t Hooft, desde la perspectiva de un observador externo, cuando un objeto atraviesa el horizonte de sucesos de un agujero negro toda la información referente a su configuración interna (moléculas, macroestructuras, etc.) se incorpora a dicho horizonte, en donde queda almacenada, bien localmente o bien de forma distribuida.

Si este principio es válido, entonces la información sobre la configuración interna de los objetos que caen a un agujero negro no se pierde, sino que permanece codificado en su horizonte de sucesos. Este último no sería una superficie “vacía” o meramente geométrica, sino que podría adoptar diferentes formas:

–Estructura granular: la superficie se discretiza en unidades minimas –análogas a los píxeles- del tamaño del área de Planck, cada uno de los cuales almacenaría una cantidad cierta de información.

–Estructura entrelazada: la información no se almacena en los píxeles de forma localizada, sino globalmente mediante el entrelazamiento cuántico.

–Estructura ondulatoria: la información se codificaría en estructuras oscilantes como branas o supercuerdas.

–Estructura algorítmica: la superficie está hecha de operaciones lógicas y procesos de cómputo cuántico. Los datos se codifican, se encriptan y se envían hacia el exterior, vía radiación de Hawking. El horizonte, en este caso, actuaría como una suerte de computador cuántico universal. Un lugar donde la física se vuelve algoritmo. Donde espacio y código son lo mismo.

Límite de Bremermann

El límite de Bremermann fue enunciado por el físico alemán Hans Joachim Bremermann en el año 1962. Éste establece una cota máxima de velocidad de procesamiento -medida en bits por segundo- que puede alcanzar cualquier sistema físico el Universo. Su formulación surge de la combinación de principios relativistas, como la equivalencia de masa-energía, con la incertidumbre propia de las mediciones cuánticas.

La formulación algebraica del mismo es bastante simple:

donde R es el número de bits por segundo, M es la masa del cuerpo que va a realizar la computación, E su energía en reposo, c la velocidad de la luz y ħ la constante reducida de Planck, de importancia fundamental en el ámbito cuántico y microscópico. El lector habrá notado que para pasar del segundo al tercer término de la ecuación se ha utilizado la célebre relación einsteniana de equivalencia entre masa energía E = mc2.

Este límite es deducido, principalmente, a partir del principio de incertidumbre de Heisenberg que, en una de sus formulaciones, afirma que cuanto menor sea el intervalo temporal de medición de la energía de un sistema, menor será la precisión de la misma. Así, de este modo:

ΔEΔt ≤ ħ/2

ΔE ≤ ħνreloj/2

donde E es la precisión de la medición de la energía, Δt el periodo de la medición y ħ la constante reducida de Planck.

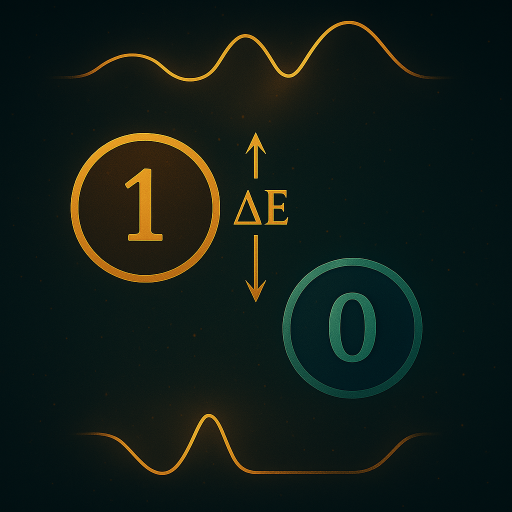

En el contexto de un ordenador, ΔE describe la diferencia energética entre los estados lógicos 0 y 1; y Δt equivale a la duración de un ciclo del reloj (y por lo tanto, al inverso de su frecuencia ν). Cuanto mayor sea la frecuencia de acceso a un registro mayor debe ser la separación energética entre los estados, para evitar que se vuelvan indistinguibles.

Figura 3. Como consecuencia el principio de incertidumbre de Heisenberg, la diferencia de energía ΔE entre dos estados lógicos determina la frecuencia máxima a la que puede funcionar el ordenador. Ésta es la base del límite de Bremermann.

Imaginemos ahora un computador ideal, extraordinariamente eficiente, con n registros que almacenan un sólo bit (en arquitectura de ordenadores, este tipo de registros suelen denominarse banderas o flags). Esta configuración representa el estado de entropía lógica máxima.

Si la energía total disponible es Etotal, entonces la energía Δebit por registro/bit es:

Δebit ≤ Etotal/n

En virtud del principio de incertidumbre de Heisenberg, para que las mediciones de los registros sean fiables, la frecuencia del reloj no puede superar:

νreloj ≤ 2Δebit/πħ ≤ 2Etotal/nπħ

De este modo, la tasa máxima de procesamiento de información del computador -medida en bits por segundo- viene dada por el producto del número de registros y frecuencia del reloj:

bits/seg = nνreloj = 2Etotal/πħ

Dado que el límite de Bremermann incorpora la relación relativista E = mc2, su aplicación práctica se restringiría a procesadores que operaran a muy altas energías, con partículas (ya sean electrones o qubits) moviéndose a velocidades muy cercanas a las de la luz. Evidentemente, el límite efectivo para los computadores ordinarios que operan en un escenario no relativista es mucho más bajo. Por lo demás, el límite ha sido objeto de debate no es universalmente aceptado en la física contemporánea, por no tener en cuenta los efectos de la relatividad general. Es posible que su relevancia se restrinja a los procesos computacionales que hipotéticamente pudieran tener lugar en las inmediaciones del horizonte de sucesos de un agujero negro y a los que hemos hecho referencia en párrafos anteriores.

Lecturas Recomendadas

– Bekenstein, Jacob (1972). «Black Holes and Entropy«.

– Hawking, Stephen (1974). «Black Hole Explosions?«.

– ‘t Hooft, Gerhardus (1993). «Dimensional Reduction in Quantum Gravity«.

– Bremermann, Hans Jacob (1962). «Optimization through evolution and recombination«.